Ende 2024 sorgte ein Artikel im Fachmagazin „Science“ für Aufsehen: Unter dem Titel „Googles DeepMind entwickelt eine KI, die uns davon abhalten soll, einander zu hassen“ wurde der Name des Konsensphilosophen Jürgen Habermas für eine fragwürdige Technologiepropaganda vereinnahmt. Was zunächst wie eine kuriose Fußnote der Technikgeschichte wirkte, entpuppt sich bei näherer Betrachtung als Symptom einer tiefgreifenden Krise der demokratischen Öffentlichkeit.

Die so genannte Habermas-Maschine von DeepMind versprach, mittels großer Sprachmodelle die gemeinsamen Perspektiven von Diskussionsteilnehmern zu erfassen und in einer „Gruppenaussage“ so zu bündeln, dass alle Beteiligten zustimmen könnten. Das System gelange dabei zu „besseren Ergebnissen“ als ein menschlicher Mediator.

Die Ironie könnte kaum größer sein: Google, das Mutterunternehmen von DeepMind, gehört zu jenen Konzernen, die durch die digitale Disruption maßgeblich zur Zerstörung einer funktionsfähigen digitalen Öffentlichkeit beigetragen haben. Dasselbe Unternehmen tritt nun mit einer KI an, die das nicht zuletzt durch KI selbst befeuerte Problem der gesellschaftlichen Polarisierung beheben soll. Doch der Name des bedeutendsten damals noch lebenden Demokratiephilosophen wurde für dieses Unterfangen, wie sich herausstellte, ohne dessen Einwilligung und ohne ein Recht dazu verwendet. Denn eine Habermas-Maschine kann es gar nicht geben.

So etwas geht nur in der ersten Person

Als der Philosoph Anfang 2025 vom Verfasser dieses Artikels auf die Verwendung seines Namens aufmerksam gemacht wurde, reagierte er mit einem Brief, der seinen Ärger deutlich erkennen lässt und zugleich eine präzise philosophische Gegenkritik formuliert: „Ein KI-Programm für praktische Diskurse ist nach meiner Auffassung schon deshalb nicht möglich, weil die jeweils aktuell Beteiligten im Hinblick auf eine faire Verallgemeinerung der jeweils berührten und in der Regel konfligierenden Interessen darin eine Bedingung erfüllen sollen, die sie nur aus der Perspektive der ersten Person erfüllen können.“

Nur so aber könnten im Diskurs die eigenen Interessen und Wertorientierungen im Lichte der Interessen und Wertorientierungen aller anderen Betroffenen beurteilt und gegebenenfalls angepasst werden. Eine Maschine kann diese Rolle nicht übernehmen, weil sie keine persönliche Perspektive entwickelt, nicht zur Abwägung von Gründen, Überzeugungen und Gefühlen fähig ist – und nicht in der Lage ist, die eigenen Einstellungen aus der Beteiligtenperspektive heraus zu überprüfen und zu ändern. Auch die Stellvertretung einer Person durch einen KI-Agenten muss am selben Grundproblem scheitern. Habermas schreibt: „Jedem Diskursteilnehmer wird in persona die anspruchsvolle Aufgabe einer sensiblen gegenseitigen Perspektivenübernahme zugemutet, aus der er oder sie die jeweils eigenen Interessen und Wertorientierungen im Lichte der ebenso berührten und gegebenenfalls beeinträchtigten Interessen und Wertorientierungen aller anderen möglicherweise Betroffenen beurteilen und gegebenenfalls an diese anpassen kann.“

Die DeepMind-KI täuscht den Diskursteilnehmern vor, ein Geschehen zu objektivieren, als hätte sie selbst daran teilgenommen oder als würde sie die individuellen Gewichtungen der Sprecher verstehen und eine neutrale Beobachterperspektive einnehmen. Dabei objektiviert sie aus Daten der Debattenteilnehmer heraus lediglich auf der Basis mathematischer Hochrechnungen und erweckt dabei nur den Anschein, auch die erste Person vertreten zu können.

Der aufrichtige Input aller Diskursteilnehmer

„Der Diskurs“, so Habermas, „verlangt nicht nur den aufrichtigen Input aller Teilnehmer aus der Erstpersonenperspektive, sondern auch die jeweils aus der Perspektive der ersten Person vorgenommen Akte der Verallgemeinerung. Dieses Ja- und Nein-Sagen kann den Beteiligten nicht aus der Drittpersonenperspektive abgenommen werden, weil die Abwägung und gegebenenfalls Korrektur der je eigenen Überzeugungen Sache des Einzelnen sind.“ Offenbar habe sich DeepMind über die „epistemischen Rollen der ersten, zweiten und dritten Person Singular“ nicht genügend Gedanken gemacht.

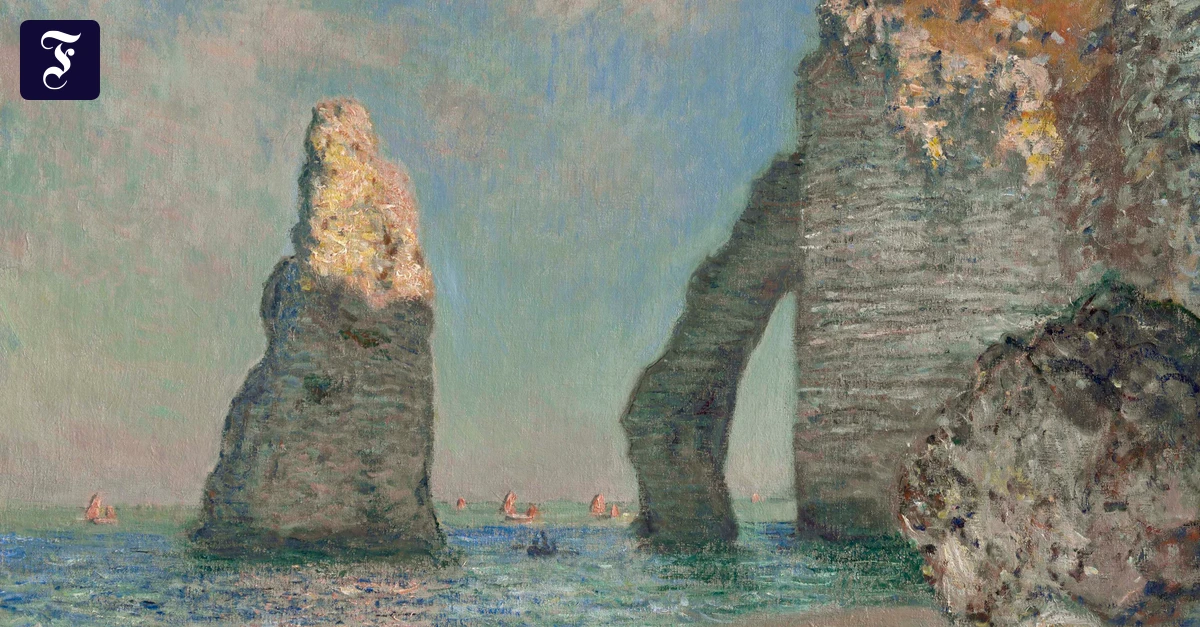

Jürgen Habermas, 2018dpa

Jürgen Habermas, 2018dpaDie individuellen Meinungen und Wertorientierungen sind schon deshalb nicht an eine objektivierende Maschine abtretbar, weil der Wechsel von der Teilnehmer- zur Beobachterperspektive im Diskurs voraussetzt, dass die Personen, die urteilen, zugleich auch Teilnehmer sind. Zudem unterstellen sie sich wechselseitig, dass sich diese Einstellungen durch andere Perspektiven, neue Fakten und die Übernahme anderer Perspektiven eben auch ändern können. Was in den Konsens eingeht, ist Resultat einer solchen Deliberation, die nur eingeübt, nicht aber automatisiert werden kann. Habermas verweist in dem Brief auf eine Veröffentlichung, in der er mit Bezug auf Wilhelm von Humboldts Sprachphilosophie die „erkenntnistheoretischen Voraussetzungen der moralischen Kognition“ entwickelt. Nur wer diese Voraussetzungen ignoriert, schreibt einer KI eine epistemische Autorität zu.

Hinzu tritt die dritte Dimension des Gesprächs: sein Sachbezug. Seit Platon unterscheidet sich Dialektik als sachorientiertes Miteinander-Reden von Rhetorik als bloßem Überreden gerade darin, dass sich die Gesprächspartner gemeinsam auf Tatsachen beziehen, auf eine Sache, die jenseits ihrer je subjektiven Perspektive liegt. KI ist zu einem solchen Welt- und Sachbezug nicht fähig. Sie verarbeitet lediglich Daten, in die menschlicher Weltbezug eingeflossen ist, aber hat keinen eigenen.

Die moralische Einheit wird gesprengt

Habermas hat bereits in einer früheren Schrift die Bedeutung der intersubjektiven Kommunikation für die Entstehung und die Beurteilung von Normativität hervorgehoben: „Das reziproke Verhältnis zwischen Ich und Du bildet die kleinste moralische Einheit.“ Diese moralische Einheit wird aufgesprengt, wenn der Dialogpartner im Alltag, bei der Wissensvermittlung, ja, sogar in der Erziehung junger Menschen zunehmend eine KI ist. Ein Gespräch setzt voraus, dass der andere recht haben könnte. Das aber ist nur im gleichberechtigten Dialog unter freien und gleichen Bürgern möglich, nicht im Sprechen mit einer Maschine. Konsens auf Knopfdruck muss also weiterhin Illusion bleiben – es sei denn, wir wollen uns der Agenda von Big Tech und Alt Right unterwerfen und Autonomie durch maschinelle Manipulation und die Demokratie durch eine Algokratie ersetzen.

Schon länger haben einige wenige Technologiekonzerne die digitale Öffentlichkeit in historisch beispielloser Weise neu vermachtet. Mit den sozialen Medien und den Effekten der Plattformökonomie haben sie die Ökonomie der Aufmerksamkeit oligopolisiert und wirtschaftliche, technische sowie politische Macht in den Händen weniger konzentriert. Weitgehend ungebremst von gesetzlicher Regulierung, untergräbt diese Entwicklung zunehmend die Autonomie der Bürger und die Souveränität demokratischer Staaten.

Mit der Einführung von KI-Agenten, die die klassische Suchmaschine ersetzen, erhält diese Machtkonzentration derzeit einen weiteren Schub. Informationen werden automatisiert generiert und dargeboten, die Quellen des Wissens werden zunehmend verschüttet. Habermas selbst sprach 2022 von einem „Neuen Strukturwandel der Öffentlichkeit“, sechzig Jahre nach seinem epochalen Frühwerk, hat er diese Entwicklung selbst analysiert. „Wir sind noch weit davon entfernt, die Digitalisierung der Kommunikation zu verdauen“, schrieb der späte Habermas, „und schon steht die nächste Umwälzung durch Technologien der künstlichen Intelligenz vor der Tür.“

Aura des Geistigen, für kommerzielle Zwecke vereinnahmt

DeepMind hatte nach Bekanntwerden von Habermas’ Reaktion versprochen, künftig auf die Verwendung seines Namens zu verzichten. Doch das hält das Unternehmen nicht davon ab, seine Konferenzräume nach toten Denkern zu benennen und so die Aura des Geistigen für kommerzielle Zwecke zu vereinnahmen. CEO Demis Hassabis lässt sein Londoner Hauptquartier als „Kathedrale des Wissens“ einrichten – mit Räumen, die nach Newton, Leibniz, Leonardo da Vinci anderen benannt sind. „Ich habe DeepMind immer als Hommage an die Intelligenz betrachtet“, sagt er. Gemeint ist wohl eher die künstliche als die menschliche.

Die entscheidende Frage bleibt: Wie können wir die kommunikative Vernunft bewahren und mit ihr die Spuren „vernünftiger Freiheit“ (Habermas), wenn die Menschen zunehmend mit einer KI sprechen und sich von ihr leiten lassen, der sie tendenziell mehr vertrauen als sich selbst und den Mitmenschen? Der bedeutendste Philosoph der Kommunikation ist gestorben. Nun gilt für uns, was er selbst vor kurzem mit Blick auf die neue weltpolitische Unordnung sagte: Von hier aus müssen wir allein weitergehen.

Statt den Versprechen künftiger Konsensmaschinen zu vertrauen, die Allwissenheit vortäuschen, um für ihre Betreiber Allmacht zu sichern, bedarf es einer Kritischen Theorie des Digitalen. Den großen Philosophen ehren wir am besten, wenn wir diese Theorie entwickeln. Dafür müssen wir mit Habermas weiter - und, angesichts der Bedrohungen durch eine vermeintlich Künstliche Intelligenz, auch über ihn hinausdenken.

Matthias Pfeffer ist Gründungsdirektor des Council for European Public Space, das eine europäische Öffentlichkeit im Sinn von Habermas schaffen will. Im Mai erscheint von ihm: „Die offene Zukunft und Ihre Feinde. Wie wir die freie Gesellschaft vor der KI-Diktatur bewahren können“ (mit Jürgen Pfeffer und Paul Nemitz; Dietz Verlag).

vor 2 Stunden

1

vor 2 Stunden

1

English (US) ·

English (US) ·