Welche Rolle spielt KI im ungarischen Wahlkampf?

Eine zentrale. KI-generierte Bilder, Videos und Tonaufnahmen sind allgegenwärtig. Täuschend echte Deepfakes sind zwar selten, doch auch überzeichnete oder karikaturhafte Inhalte entfalten Wirkung.

Wie sieht das konkret aus?

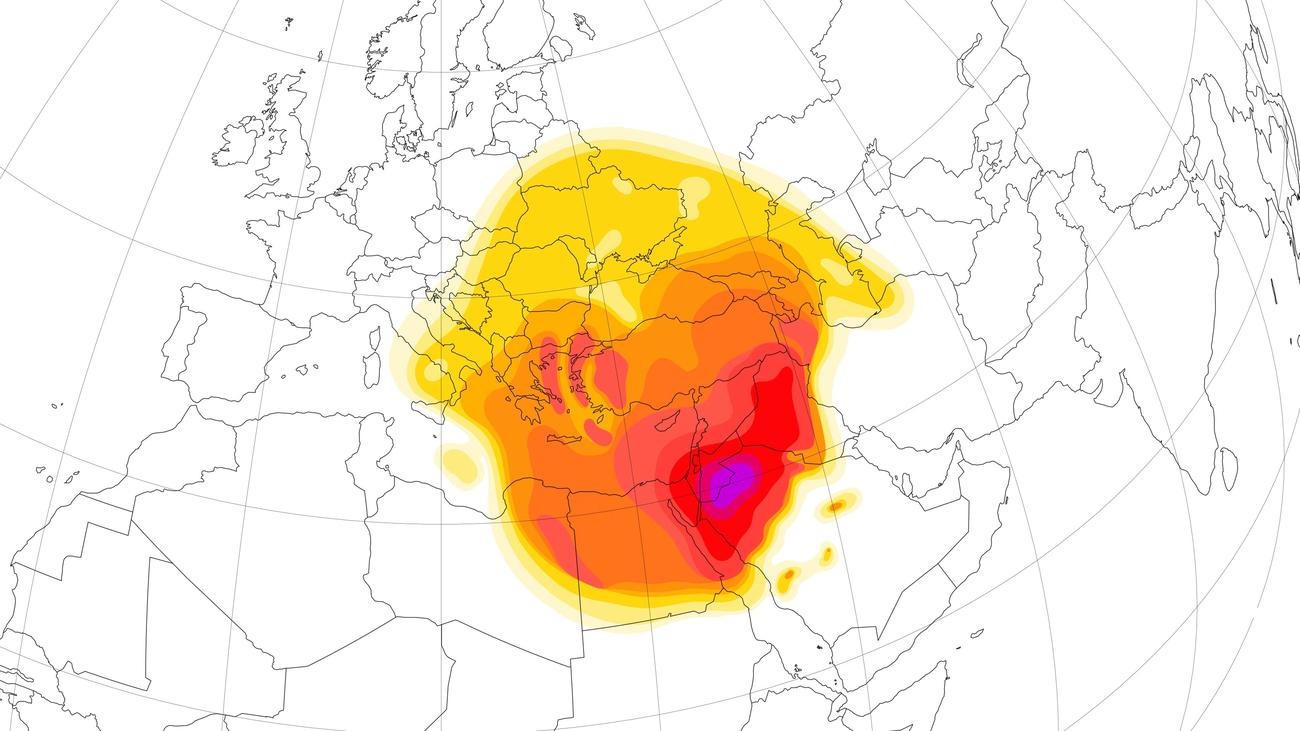

Ein Beispiel dafür sind manipulierte Zitate, die nicht mehr nur als Text oder als klassisches Kampagnenvideo verbreitet werden. Sie werden in KI-generierte Videos eingebaut, in denen die betroffene Person scheinbar selbst spricht. Diese Verbindung aus klassischer Manipulation und künstlicher Inszenierung ist besonders problematisch. Ein anderes Beispiel: Ein von der Regierungsseite verbreitetes KI-Video zeigte ungarische Soldaten, die in der Ukraine kämpfen und am Ende in Särgen zurückkehren. Das knüpft unmittelbar an die zentrale Propagandabotschaft der Regierung an, Ungarn solle in den Krieg hineingezogen werden.

Was ist neu an diesen Manipulationen?

Der Realismus – und die Masse. KI ermöglicht es, Inhalte schnell, günstig und in großer Zahl zu produzieren. Dadurch lässt sich eine Botschaft leicht wiederholen und einhämmern. Besonders bei unentschlossenen Wählern kann das Wirkung zeigen. Allerdings bleibt dies im ungarischen Kontext bislang eher eine plausible Hypothese, zu der es noch keine Studien gibt.

Im Sommer 2025 gab die regierungsnahe „Nationale Widerstandsbewegung“ rund 670.000 Euro für Werbung auf Facebook und Youtube aus und erzielte 650 Millionen Einblendungen. Dabei setzte sie massiv auf KI-Videos gegen den Herausforderer Péter Magyar. Ist KI ein systematisches Werkzeug der Orbán-Regierung?

In gewisser Weise ja. Nicht unbedingt, weil hier die technisch ausgefeiltesten Inhalte produziert würden, sondern weil KI in Ungarn auf ein hoch entwickeltes Propagandasystem trifft. Dadurch kann sie sehr schnell in die Breite gehen. Was in anderen Ländern an den Rändern zirkuliert, gelangt hier direkt in den politischen Mainstream.

Vor der niederländischen Parlamentswahl im Oktober 2025 lösten KI-Bilder über Frans Timmermans – etwa eines, das ihn in Handschellen zeigte – einen Skandal aus. Warum bleibt die Empörung in Ungarn bei ähnlichen Inhalten aus?

Weil die Menschen nach 16 Jahren Orbán-Regierung an solche Wahlkampfmethoden gewöhnt sind. Früher montierte man Oppositionspolitiker mit Photoshop – etwa mit einem Bolzenschneider am Grenzzaun oder an der Seite von George Soros. Heute hat sich vor allem die Technologie verändert: Die Bilder wirken realistischer. Die Diffamierung des politischen Gegners bleibt jedoch dieselbe. Hinzu kommt die extreme Polarisierung. Während die Gegenseite empört reagiert, herrscht im eigenen Lager oft die Haltung, dass im politischen Kampf fast alles erlaubt ist.

Szilárd TeczárEuropean University Institute

Szilárd TeczárEuropean University InstituteHalten Sie die neuen KI-Technologien für gefährlicher als frühere Formen visueller Manipulation?

Das hängt stark davon ab, wie medienkompetent die jeweiligen Nutzer sind. Es gibt Inhalte, bei denen für Sie und mich sofort erkennbar ist, dass sie künstlich erzeugt wurden. Wenn Ursula von der Leyen plötzlich auf Ungarisch bei Péter Magyar anruft und ihm befiehlt, Geld in die Ukraine zu schicken, ist uns sofort klar, dass das nicht echt ist. Doch ob etwa ein ungarischer Rentner, der digital wenig versiert, aber auf Facebook unterwegs ist, ein solches Video sofort als KI erkennt, halte ich für fraglich.

Was hat sich über die Nutzung von KI hinaus im digitalen Desinformationsumfeld des Wahlkampfs verändert?

Die andere große Veränderung betrifft die Regulierung. Die neuen europäischen Regeln haben die politische Onlinewerbung beeinflusst. Plattformen wie Meta und Google haben politische Werbung in der EU offiziell eingestellt. Dadurch ist die offen sichtbare Werbeflut kleiner geworden. Das bedeutet aber nicht, dass die politische Einflussnahme verschwunden wäre. Regierungsnahe Akteure umgehen die Regeln über Proxyseiten, scheinbar unabhängige Kampagnenstrukturen und andere Grauzonen.

Welche Rolle spielt die EU in dieser Propaganda?

Für das Orbán-Lager ist die EU nicht nur politischer Gegner, sondern auch zentrales Feindbild. EU-Dokumente werden verzerrt, Aussagen westlicher Politiker umgedeutet, und die Unterstützung für die Ukraine wird als Bedrohung für Ungarn dargestellt.

In welchem Maß spiegelt die Regierungspropaganda Narrative des Kremls?

Sie fügt sich oft nahtlos in diese ein. Das bedeutet nicht, dass jede Botschaft direkt aus Moskau stammt. Doch strukturell entspricht vieles der russischen Propaganda in Europa. In Ungarn müssen solche Narrative oft nicht importiert werden – regierungsnahe Politiker, Medien und Proxystrukturen verbreiten sie von selbst.

Was ist aus Ihrer Sicht das gefährlichste Szenario für künftige europäische Wahlkämpfe?

Täuschend echte Videos oder Tonaufnahmen, die kaum noch als künstlich erkennbar sind. Dann könnte eine Situation entstehen, in der echte Aufnahmen als KI-Fälschungen abgetan und künstliche Aufnahmen für echt gehalten werden. Die eigentliche Gefahr liegt weniger in der einzelnen Fälschung als in der Erosion der Wirklichkeitswahrnehmung.

Was müsste sich ändern, um die Widerstandskraft gegen solche Kampagnen zu stärken?

Es braucht ein starkes, unabhängiges Mediensystem und mehr Medien- und Digitalkompetenz. Zudem herrscht eine rechtliche Grauzone. Der Einsatz von KI in der politischen Kommunikation sollte reguliert werden, etwa durch Kennzeichnungspflichten. Es gibt auch Vorschläge, die Generierung von KI-Inhalten über reale Personen generell zu verbieten.

vor 2 Tage

3

vor 2 Tage

3

English (US) ·

English (US) ·